Gehört zu: Physik

Siehe auch: Quantenmechanik, Die Bra-Ket-Notation, Wellenfunktion, Komplexe Zahlen

Stand: 10.04.2024

Quantenmechanik nach Susskind

Warnung / Disclaimer

Diesen Blog-Artikel schreibe ich ausschließlich zu meiner persönlichen Dokumentation; quasi als mein elektronisches persönliches Notizbuch. Wenn es Andere nützlich finden, freue ich mich, übernehme aber kleinerlei Garantie für die Richtigkeit bzw. die Fehlerfreiheit meiner Notizen. Insbesondere weise ich darauf hin, dass jeder, der diese meine Notizen nutzt, das auf eigene Gefahr tut.

Wenn Podukteigenschaften beschrieben werden, sind dies ausschließlich meine persönlichen Erfahrungen als Laie mit dem einen Gerät, welches ich bekommen habe.

Bei Youtube bin ich auf die Vorlesungen von Prof. Susskind an der Stanfort University gestossen (“continued education”).

Professor Susskind beschreibt die für die Quantenmechanik erforderliche Mathematik einfach und anschaulich, was nicht immer ganz genau der reinen Mathematik entspricht. Deswegen kann ich es gut verstehen.

Zunächst betrachten wir klassische Physikalische Systeme, danach gehen wir Zug um Zug in die Welt der Quantenphysik.

In der Quantenphysik werden wir es immer wieder mit Komplexen Zahlen zu tun haben. Auch der Begriff der komplex konjugierten wird hier eine große praktische Rolle spielen.

Letztendlich wird der Zustand eines Quantenmechanischen Systems (z.B. Spin eines Elektrons) durch einen Vektor in einem Hilbertraum (Vektorraum mit Innerem Produkt) beschrieben. Die Dimension eines solchen Hilbertraums ist durch die Anzahl der messbaren Zustände gegeben. Die Summe der Wahrscheinlichkeiten aller Zustände muss Eins ergeben; d.h. es ist nicht der ganze Hilbertraum, sondern nur ein Teilraum der “normierten” Vektoren; z.B. der Einheitskreis.

Ket-Vektor

Ein physikalisches System kann verschiedene diskrete Zustände annehmen (ggf. approximiert).

- Z.B. Das Werfen einer Münze: Kopf oder Zahl

- Z.B. Ein Würfel: Eins, Zwei, Drei, Vier, Fünf oder Sechs

- Z.B. Spin eines Elektrons: Up oder Down

So einen Zustand schreiben wir auf als sog. “Label” in sog. Ket-Schreibweise…

- z.B. |Kopf> oder |Zahl>

- z.B. |Eins> oder |Zwei> oder…

- z.B. |Up> oder |Down>

Wir können jeden Zustand (State) durch einen Spalten-Vektor repräsentieren.

\( |Kopf> \space —> \left( \begin{array}{c} 1 \\\ 0 \end{array}\right) \)

und

\( |Zahl> \space —> \left( \begin{array}{c} 0\\\ 1 \end{array}\right) \\ \)

Oder beim Würfel:

\( |Eins> \space —> \left( \begin{array}{c} 1 \\\ 0 \\\ 0 \\\ 0 \\\ 0 \\\ 0 \end{array}\right) \) und \( |Zwei> \space —> \left( \begin{array}{c} 0 \\\ 1 \\\ 0 \\\ 0 \\\ 0 \\\ 0 \end{array}\right) \) und …

Man sagt auch |a> sei ein Vektor, obwohl der zugehörige Spaltenvektor “nur” eine Repräsentation von |a> ist. Manchmal identifizieren wir beides (aus Bequemlichkeit).

Die Menge der möglichen Zustände nennt man auch “Zustandsraum“. Beispielsweise:

\( S = \left\{ \left( \begin{array}{c} 1 \\\ 0 \end{array}\right) , \left( \begin{array}{c} 0\\\ 1 \end{array}\right) \right\} \\ \)

Der Zustand eines physikalischen Systems könnte sich mit der Zeit ändern. Den Zustand zu einem bestimmten Zeitpunkt nennt man auch “Konfiguration“.

Später werden wir sehen, wie dieser Zustandsraum einen zu einem Vektorraum erweitert werden kann (der Vektorraum wird aufspannt).

Bra-Vektor

Zu jedem Ket-Vektor |a> bilden wir einen sog. Bra-Vektor <a| auf folgende Weise:

Der Ket-Vektor sei:

\( |a> \space —> \left( \begin{array}{c} a_1 \\\ a_2 \\\ a_3 \end{array}\right) \\ \)

dann bilden wir den zugehörigen Bra-Vektor als Zeilenvektor folgendermaßen:

\( <a| \space —> \left( \begin{array}{r} {a_1}^* & {a_2}^* & {a_3}^* \end{array}\right) \\ \)

Wir sagen, der Bra-Vektor sei das komplex konjugierte zum Ket-Vektor

Inneres Produkt

Das sog. “Innere Produkt” zweier Vektoren definieren wir nun einfach als:

\( <a|b> = \left( \begin{array}{r} {a_1}^* & {a_2}^* & {a_3}^* \end{array}\right) \cdot \left( \begin{array}{c} b_1 \\\ b_2 \\\ b_3 \end{array}\right) = {a_1}^* b_1 + {a_2}^* b_2 + {a_3}^* b_3 \\ \)

Das Innere Produkt eines Vektors mit sich selbst ist dann immer eine reelle Zahl. Wir definieren als “Länge” oder auch “Norm” eines Vektors die positive Wurzel aus diesem Inneren Produkt.

Wenn das Innere Produkt zweier Vektoren Null ist, sagen wir sie seien “orthogonal”.

Observable

Observable nennt man physikalische Größen, die man mit einem Experiment messen kann; also eine Messgröße. So eine Observable ist immer eine nicht negative reelle Zahl.

In einem bestimmten physikalischen Experiment wollen wir eine bestimme Größe messen und bekommen so zu jedem Zustand des Systems einen Messwert.

Eine bestimmtes physikaliches Mess-Experiment M ordnet also jedem Zustand aus dem Zustandsraum S einen Messwert (reelle Zahl) zu. Mathematisch geschrieben:

\( M: S \to \mathbb{R} \)

Abstrakter Vektorraum

Die Ket-Vektoren |a> bilden einen (abstrakten) Vektorraum; d.h. es gelten bestimmte Regeln:

Regel 1: Jeder Vektor aus dem Vektorraum kann mit einem Skalar (komplexe Zahl) mutipliziert werden, wobei das Ergebnis wieder ein Vektor aus dem Vektorraum ist.

\( \lambda \space | a> = | a^\prime> \)

Regel 2: Zwei Vektoren aus dem Vektorraum kann ich addieren, wobei das Ergebnis wieder ein Vektor aus dem Vektorraum ist.

\( | a > + | b > = | c > \)

Beispiele von Vektorräumen

Die Menge der Ket-Vektoren bilden einen Vektorraum, wobei wir als Einträge ganz allgemein Komplexe Zahlen zulassen und die Dimension des Vektorraums gleich der Anzahl verschiedener Zustände ist.

Die oben aufgeführten Regeln für Vektorräume gelten offenbar:

\( \lambda \left( \begin{array}{c} a_1 \\\ a_2 \\\ a_3 \end{array}\right) = \left( \begin{array}{c}\lambda a_1 \\\ \lambda a_2 \\\ \lambda a_3 \end{array}\right) \\\)

\( \left( \begin{array}{c} a_1 \\\ a_2 \\\ a_3 \end{array}\right) + \left( \begin{array}{c} b_1 \\\ b_2 \\\ b_3 \end{array}\right) = \left( \begin{array}{c} a_1 + b_1 \\\ a_2 + b_2 \\\ a_3 + b_3\end{array}\right) \)

Linearkombinationen

Wir können jeden Ket-Vektor | a > als Linearkombination der Zustandsvektoren darstellen:

\( | a > = \left( \begin{array}{c} a_1 \\\ a_2 \\\ a_3 \end{array}\right) = a_1 \left( \begin{array}{c} 1 \\\ 0 \\\ 0 \end{array}\right) + a_2 \left( \begin{array}{c} 0 \\\ 1 \\\ 0 \end{array}\right) + a_3 \left( \begin{array}{c} 0 \\\ 0 \\\ 1 \end{array}\right) \\\)

Damit spannen die Zustandsvektoren einen (abstrakten) Vektorraum auf, aber nicht jeder Vektor aus diesem Vektorraum beschreibt einen physikalischen Zustand – …

Quantenmechanisches Beispiel

Wenn ich den Spin eines quantenmechanischen Elektrons messe, bekomme ich bei jeder Messung einen von zwei Zuständen, die wir | up > und | down > nennen können.

Diese beiden Zustände repräsentieren wir durch zwei Spaltenvektoren im Vektorraum:

\( | up > \space —> \left( \begin{array}{c} 1 \\\ 0 \end{array}\right) \\ \) und

\( | down > \space —> \left( \begin{array}{c} 0\\\ 1 \end{array}\right) \\ \)

In der klassischen Physik würde niemand auf die Idee kommen, Linearkombinationen solcher zwei Zustände zu betrachten. In der Quantenpysik machen wir das aber.

Linearkombination dieser beiden Zustände wären also:

\( a_{up} \space | up > + a_{down} \space | down > \\\)

Die Koeffizienten können wir als Spaltenvektor schreiben:

\( a = \left( \begin{array}{c} a_{up} \\\ a_{down} \end{array}\right) \\\)

Wobei die Beträge der Komponenten (Koeffizienten der Linearkombination) interpretiert werden als die Wahrscheinlichkeiten der Zustände; also:

\( P_{up} = a_{up} {a_{up}}^* \\\) und

\( P_{down} = a_{down} {a_{down}}^* \\\)

Wobei natürlich die Summe der Wahrscheinlichkeiten 1 ergeben muss: \( P_{up} + P_{down} = 1 \)

Alle Linearkombinationen der Ket-Vektoren | up > und | down >, die diese Bedingung (Summe der Wahrscheinlichkeiten = 1) erfüllen, werden in der Quantenmechanik als physikalisch mögliche Zustände angesehen. Wir können diese Bedingung auch schreiben als:

\( P_{up} + P_{down} = a_{up} {a_{up}}^* + a_{down} {a_{down}}^* = \left( \begin{array}{r} {a_{up}}^* & {a_{down}}^* \end{array}\right) \cdot \left( \begin{array}{c} a_{up} \\\ a_{down} \end{array}\right) = <a|a> = 1 \)

Die Bedingung ist also: “Länge = 1”; d.h. die quantenmechanisch möglichen Zustände des Elektronen-Spins liegen auf dem Einheitskreis.

Das Besondere in diesem Fall also, dass der Elektronenspin zwar gequantelt ist, also nur diskrete Werte (+1 und -1) annehmen kann, aber die Wahrscheinlichkeiten beim Messvorgang durchaus gebrochene Zahlen sein können.

Matrizen

Wir werden Matrizen brauchen. Wofür, sehen wir später.

Eine Matrix ist einfach eine quadratische Anordnung von Zahlen, beispielsweise:

\( M = \left( \begin{matrix} m_{11} & m_{12} & m_{13} \\ m_{21} & m_{22} & m_{23} \\ m_{31} & m_{32} & m_{33} \\ \end{matrix} \right) \\ \)

So eine Matrix M können wir anwenden auf einen Spaltenvektor v indem wir im Prinzip die inneren Produkte von Matrix-Zeilen mit dem Spaltenvektor bilden:

\( M v = \left( \begin{matrix} m_{11} & m_{12} & m_{13} \\ m_{21} & m_{22} & m_{23} \\ m_{31} & m_{32} & m_{33} \\ \end{matrix} \right) \left( \begin{array}{c} v_1 \\\ v_2 \\\ v_3 \end{array}\right) = \left( \begin{array}{c} m_{11} v_1 + m_{12} v_2 + m_{13} v_3 \\\ m_{21} v_1 + m_{22} v_2 + m_{23} v_3 \\\ m_{31} v_1 + m_{32} v_2 + m_{33} v_3\end{array}\right) \\ \)

Das Ergebnis ist wieder ein Spaltenvektor.

Wenn wir nun einen Zeilenvektor w und eine Matrix M nehmen, sieht das ganz analog aus:

\( w M = \left( \begin{array}{c} w_1 & w_2 & w_3 \end{array}\right) \left( \begin{matrix} m_{11} & m_{12} & m_{13} \\ m_{21} & m_{22} & m_{23} \\ m_{31} & m_{32} & m_{33} \\ \end{matrix} \right) = \left( \begin{array}{c} w_1 m_{11} + w_2 m_{21} + w_3 m_{31} & w_1 m_{12} + w_2 m_{22} + w_3 m_{32} & w_1 m_{13} + w_2 m_{23} + w_3 m_{33} \end{array}\right) \\ \)

Das Ergebnis ist wieder ein Zeilenvektor.

Matrizen als Operatoren auf einem Vektorraum

Matrizen kann man auch “Operatoren” nennen. Sie können die Vekoren eines Vektorraums transformieren. Das allgemeine KOnzept heißt “Linearer Operator” oder auch “Lineare Transformation”. Wir identifizieren diese zur Vereinfachung.

Wir schauen uns mal ein paar Beispiele aus dem 2-dimensonalen reellen Vektorraum an.

Beispiel 1: Stretchen um einen Faktor 2

\( M v = \left( \begin{matrix} 2 & 0 \\ 0 & 2 \end{matrix} \right) \left( \begin{array}{c} v_x \\\ v_y \end{array}\right) = \left( \begin{array}{c} 2 v_x \\\ 2 v_y \end{array}\right) \\ \)

Beispiel 2: Stretchen in Richtung der y-Achse

\( M v = \left( \begin{matrix} 1 & 0 \\ 0 & 2 \end{matrix} \right) \left( \begin{array}{c} v_x \\\ v_y \end{array}\right) = \left( \begin{array}{c} v_x \\\ 2 v_y \end{array}\right) \\ \)

Beispiel 3: Rotieren um 90 Grad im Uhrzeigersinn

\( M v = \left( \begin{matrix} 0 & 1 \\ -1 & 0 \end{matrix} \right) \left( \begin{array}{c} v_x \\\ v_y \end{array}\right) = \left( \begin{array}{c} v_y \\\ -v_x \end{array}\right) \\ \)

Wir sehen also: Matrizen transformieren einen Vektorraum; aber nicht alle Transformationen sind Matrizen.

Hermitische Matrizen

Observable in der Quantenphysik werden durch hermitische Operatoren dargestellt. Wir schauen hier deswegen auf hermitische Matrizen.

Eine hermitische Matrix ist definiert durch: \( m_{ij} = {m_{ji}}^* \)

Eine hermitische Matrix ist vom Konzept her so etwas wie eine reelle Transformation, aber nicht ganz genau: nur die Diagonalelemente der Matrix sind reell, die anderen Elemente werden beim Spiegeln an der Diagonale komplex konjugiert.

Die Namensgebung geht zurück auf den französischen Mathematiker Charles Hermite (1822-1901).

Hintergrund:

Zu einer Matrix \(M = (m_{ij}) \) definieren wir eine “Hermitsch konjugierte” Matrix und schreiben die mit einem “Dagger”;

\( \Large M^\dagger = (m_{ij}^*) \)

Wir nennen eine Matrix M “hermitisch”, wenn sie gleich ihrer hermitisch konjugierten ist, also wenn:

\( \Large M = M^\dagger \\ \)

Diese Eigenschaft ist so ähnlich wie \( z = z^* \) bedeutet, dass z eine reelle Zahl ist.

In der Quantenphysik werden wir es fast ausschließlich mit Hermitischen Matrizen (Hermitischen linearen Operatoren) zu tun haben.

Zusammenfassung Nr. 1 zur Quantenphysik

In der Quantenphysik geht es darum, Wahrscheinlichkeiten zu berechnen. Wahrscheinlichkeiten, dass eine Observable bei einem bestimmten Zustand des Systems einen bestimmten Wert (Messwert) annimmt.

Vektoren repräsentieren die Zustände.

Solche Zustandsvektoren bekommen eine irgendwie geartete Bezeichnung (“Label”); z.B. \( |hinz\rangle \text{ und } |kunz\rangle \).

Auch die Linearkombinationen solcher Zustandsvektoren werden als Zustände bezeichnet.

Alle solchen Linearkombinationen, im Beispiel: \( a |hinz\rangle + \enspace b |kunz\rangle \enspace mit\enspace a, b \in C \), bilden einen Vektorraum, den sog, Zustandsraum

Hermitische Matrizen repräsentieren die Observablen.

Wie ich zu einer Observablen (also einer Messgröße) die Matrix finde, ist noch ein Geheimnis.

Später werden wir sehen, dass die Eigenwerte der Matrix die Werte sind, die die Observable annehmen kann; d.h. die wir messen können.

Erwartungswert einer Observablen

Nun entspricht also eine Hermitische Matrix M einer Observablen.

In einem bestimmten Zustand | a > ist der Erwartungswert der Observablen M:

\( < a | M | a> = \text{Erwartungswert von M} \\ \)

Vergleiche dazu auch: Schroedinger

Eigenwert und Eigenvektor in der Quantenphysik

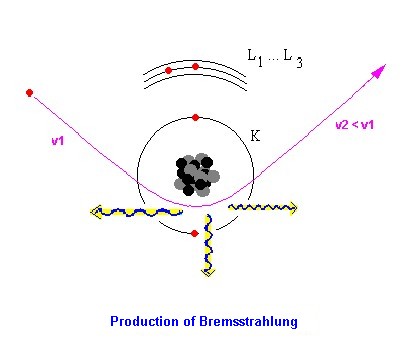

Wofür diese Konzepte gut sind, sehen wir hier in der Quantenphysik: Die Eigenwerte einer Hermitischen Matrix werden die möglichen Messwerte der Observablen sein.

Wir betrachten eine hermitische Matix M und fragen uns, ob es dazu einen Vektor |a> gibt, der durch die Matrix M nicht in der Richtung, sondern nur in der Länge verändert wird. Die Längenveränderung wäre dann ein Faktor, der vom Vektor |a> abhängt, weswegen wir in λa nennen.

\( M|a> = \lambda_a | a > \\ \)

Wenn es so etwas zu der Matrix M gibt, nennen wir so ein λa einen Eigenwert, und den Vektor |a> einen Eigenvektor der Matrix.

Der Witz in der Quantenmechanik ist, dass die Eigenwerte einer hermitische Matrix M die möglichen Messwerte der Observablen sind und der zugehörige Eigenvektor ist der Zusrand in dem die Wahrscheinlichkeit, diesen Wert zu messen 1 ist.

Wie man auf diese Matrizen kommt, die ja Observable repräsentieren sollen, ist noch völlig offen.

Wir schauen uns als Beispiele mal diagonale Matrizen an. Man sieht leicht, dass die Diagonalelemente die Eigenwerte sind und die Eigenvektoren die möglichen Einheitsvektoren aus lauter Nullen und einer Eins.

Beispiel Elektronenspin

Die Observable ist also der Spin eines Elektrons, der +1 oder -1 sein kann.

Als Matrix für diese Observable nehmen wir mal:

\( \sigma_3 = \left( \begin{matrix} 1 & 0 \\ 0 & -1 \\ \end{matrix} \right) \\ \)

Diese Matrix wird auch “Spinoperator” genannt und mit σ3 bezeichnet. Diese Matrix als Repräsentation der Observablen “Spin” fällt hier ersteinmal so vom Himmel. Wir können aber einfach nachweisen, dass es stimmt, den die Eigenwerte sind:

+1 zum Eigenvektor \( \left( \begin{array}{c} 1 \\\ 0 \end{array}\right) = |up> \) und -1 zum Eigenvetor \( \left( \begin{array}{c} 0 \\\ 1 \end{array}\right) =|down> \)

Genaugenommen steht σ3 für die Messung des Eletronenspins in z-Richtung (wieso das so ist kommt später).

In y-Richtung gemessen bekommen wir als Observable:

\( \sigma_2 = \left( \begin{matrix} 0 & -i \\ i & 0 \\ \end{matrix} \right) \\\)

In x-Richtung gemessen bekommen wir als Observable:

\( \sigma_1 = \left( \begin{matrix} 0 & 1 \\ 1 & 0 \\ \end{matrix} \right) \\ \)

Wir haben also 3 Spinoperatoren…

Wichtiger Satz über Eigenwerte (Lecture 3, t=59m)

Wenn es zu einer Observablen (hermitischen Matrix) M mehrere Eigenvektoren gibt:

\( M | a > = \lambda_a | a > \\ \)

und

\( M | b > = \lambda_b | b > \\ \)

und die Eigenwerte verschieden sind, dann sind die Eigenvektoren orthogonal; also <a|b> = 0.

Ein Eigenvektor |a> beschreibt ja einen Zustand, in dem die Wahrscheinlichket 1 ist, den Wert λa zu messen.

Wenn ich also zu einer Observablen zwei unterschiedliche Messwerte λa bzw. λb bekomme, gibt es dazu zwei orthogonale Zustandsvektoren |a> und |b>, in denen die Wahrscheinlichkeit 1 ist, die Messwerte λa bzw. λb zubekommen.

Ein Satz zu Wahrscheinlichkeiten (Lecture 3, t= 1h 14:30m)

Wir mögen ein System haben, das im Zustand |b> präpariert ist – z.B. ein Elektron haben mit dem Elektronenspin |b>

Nun betrachten wir eine Observable M mit einem Eigenwert λa zum Eigenvektor |a> .

Wenn wir in dem gegebenen Zustand |b> eine Messung mit M durchführen, können wir uns fragen, mit welcher Wahrscheinlichkeit P unser Messergebnis λa sein wird.

Prof. Susskind sagt:

\( P = \langle a|b \rangle {\langle a|b \rangle}^* \)

Quantenmechanik mit einem Elektronenspin (Lecture 4)

Wir stellen uns vor, wir hätten ein Elektron so präpariert, dass der Elektronenspin in Richtung des (räumlichen) Vektors n = (n1, n2, n3) zeigt.

Nun wollen wir den Elektronenspin dieses Elektrons entlang der Richtung m = (m1, m2, m3) messen. Das Ergebnis ist (natürlich) entweder +1 oder -1 (so merkwürdimg ist die Quantenwelt).

Dieses ganze Experiment (präparieren und dann messen) wiederholen wir sehr oft, um die Wahrscheinlichkeit P+ für das Messergebnis +1 bzw. die Wahrscheinlichkeit P– für das Messergebnis -1 zu bestimmen.

Das können wir jetzt ja ganz einfach ausrechnen. Als Ergebnis (ohne Beweis) erhalten wir, dass die Wahrscheinlichkeit nur vom (räumlichen) Winkel θ zwischen den beiden Vektoren abhängt. Der Cosinus dieses Winkels ist bekanntlich das Innere Produkt der beiden Richtungs-Vektoren:

\( \Large \cos{\theta} = \langle n, m \rangle \\ \)

Und die Wahrscheinlichkeit wird (ohne Beweis):

\( \Large P_+ = \frac{1 + \cos{\theta}}{2} \\ \)

Wichtger Zusatz: Kommutator (Lecture 4, t= 1h 54m)

Wenn wir eine Messung einer Observablen durchführen, verändern wir den Zustand des Quantensystems. (Detail: Es ändert sich der “Eigenzustand” auf einen Eigenvektor, der zu dem gemessenen Eigenwert gehört.)

Wir können also nicht zwei Messungen eines Anfangszustands machen, denn der Anfangzustand hat sich ja durch die erste Messung verändert. Das würde nur gehen, wenn die beiden Matrizen (=Observablen) die gleichen Eigenvektoren hätten.

Prof. Susskind sagt (ohne Beweis), dass zwei Matrizen A und B genau dann die gleichen Eigenvektoren haben (evtl. aber andere Eigenwerte) , wenn sie kommutieren; d.h. wenn AB = BA.

Man nennt AB – BA den Kommutator von A und B und schreibt auch:

\( [A,B] = AB – BA \\\)

Ein System mit zwei Elektronen: Entanglement (Lecture 4, t= 1h 55m)

Zunächst machen wir mal eine kleine Tabelle, wie das mit einem Elektron war:

\( \begin{array}{l} \sigma_1 | up \rangle = | down \rangle \\ \sigma_1 | down \rangle = | up \rangle \\ \sigma_2 | up \rangle = i | down \rangle \\ \sigma_2 | down \rangle = -i | up \rangle \\ \sigma_3 | up \rangle = | up \rangle \\ \sigma_3 | down \rangle = – | down \rangle \end{array} \\\)

Wenn wir nun zwei Elektronen betrachten, haben wir die vier möglichen Zustände der beiden Elektronenspins, die wir als Ket-Vektoren aufschreiben:

| u u >

| u d >

| d u >

| d d >

Diese vier spannen mit ihrern Linearkombinationen einen vierdimensionalen komplexen Vektorraum auf:

\( a | u u > + b | u d > + c | d u > + d | d d > \\ \)